Risikomanagement beim Einsatz von künstlicher Intelligenz

„Risikomanagement bezieht sich auf koordinierte Aktivitäten zur Steuerung und Kontrolle einer Organisation im Hinblick auf Risiken“

ISO 31000:2018

Etwas mit KI – das zieht immer. Insbesondere seit der allgemeinen Nutzung von ChatGPT und Stable Diffusion sind die beeindruckenden Fähigkeiten der künstlichen Intelligenz auch für Laien ohne technisches Kenntnisse leicht erfahrbar. Einen cleveren Text oder ein ansprechendes Bild zu generieren ist nun kein Hexenwerk mehr – was die Faszination rund um KI wohl nur noch verstärkt. Nicht überraschend, dass der KI-Hype damit neue Höhen erreicht. Vom interessierten Privatnutzer bis zu den Entscheidungsträgern in den Unternehmensspitzen werden blühende Zukunftsszenarien entworfen. Damit es dabei kein böses Erwachen gibt, sind da nun die Risikomanager, betraut mit der wenig glamourösen, aber essenziellen Aufgabe, die Risiken dieser Technologien zu bändigen, damit die Begeisterten ihre Visionen umsetzen können.

Die Herausforderungen

Während der Umgang von KI-Anwendung mittlerweile intuitiv ist, sind es die damit verbundenen Risiken nicht. Um nun ein effizientes Risikomanagement im Kontext KI aufzubauen bedarf es mehrerer Faktoren, die leider nur selten gegeben sind. Dazu zählt eine systematische Erfassung der genutzten (oder gerade in Entwicklung befindlichen) KI-Systeme und der möglichen Risiken dazu. Dabei beruht eine seriöse Risikoeinschätzung auf dem Wissen von Bedrohungen und deren Häufigkeit. Beide Aspekte verlangen sowohl eine gewisse Expertise als auch Erfahrung. Selbst wenn Experten aus verschiedenen Bereichen zurate gezogen werden, fehlt es häufig an verlässlichem Wissen speziell zu möglichen Risiken zum Einsatz von KI in konkreten Szenarien. Das ist nicht zuletzt darauf zurückzuführen, dass viele Modelle und Ansätze erst kürzlich entwickelt wurden und nur selten wurde dabei bereits ein Fokus auf mögliche Risiken gelegt. Damit existiert eine erhebliche Kompetenzlücke. Insbesondere für KMUs, deren Kerngeschäft nicht der Einsatz von künstlicher Intelligenz ist, aber diese gern zukünftig nutzen möchten.

Die Lücken an systematischem Umgang und die fehlenden Expertisen rund um KI-System-Risiken sind sowohl für die Risikomanager als auch für die Unternehmen problematisch. Denn während die Entwicklungszyklen für KI-Anwendungen immer kürzer werden, bleibt das Risikomanagement oft mehr als nur einen Schritt hinter der technologischen Entwicklung zurück. Hinzu kommt, dass die Auswirkungen der KI-Anwendungen nicht immer unmittelbar erkennbar sind, sondern sich manchmal erst im Laufe der Zeit manifestieren. Das erschwert nicht nur die Einschätzung der Risiken, sondern stellt auch die Frage, wie man proaktiv agieren kann, ohne die Innovationsfähigkeit zu lähmen.

Hilfestellungen – NIST und ISO

Hilfestellungen geben Rahmenwerke, die das helfen soll das Risiko systematisch zu behandeln. Die beiden auf die hier eingegangen werden soll:

- AI Risk Management Framework | NIST

- ISO/IEC 23894:2023 – Information technology — Artificial intelligence — Guidance on risk management

Natürlich haben viele Beratungsfirmen ihre ganz eigenen Whitepapers. Manche verfolgen Methodiken gemäß der genannte Rahmenwerke, andere verfolgen eigenen Ansätz und die meisten machen irgendwas dazwischen. Da hier die Bandbreite groß ist, soll es in diesem Beitrag nur um die genannten standardisierten Rahmenwerke gehen.

AI Risk Management Framework (AI RMF) der NIST

„Das AI RMF bezeichnet ein KI-System als ein technisch entwickeltes oder maschinenbasiertes System, das für einen bestimmten Satz von Zielen Ausgaben wie Vorhersagen, Empfehlungen oder Entscheidungen erzeugen kann, die reale oder virtuelle Umgebungen beeinflussen. KI-Systeme sind darauf ausgelegt, mit unterschiedlichen Grad an Autonomie zu arbeiten (Angepasst von: OECD Recommendation on AI:2019; ISO/IEC 22989:2022).“

AI RMF

Das AI Risk Management Framework (AI RMF) ist ein Rahmenwerk des National Institute of Standards and Technology (NIST), das darauf abzielt, Unternehmen bei der Identifikation, Bewertung und Steuerung von Risiken beim Einsatz von KI-Systemen zu unterstützen. Das Rahmenwerk sei dabei so konzipiert, dass es branchenunabhängig und Use-Case-orientiert agiert. Damit soll es Unternehmen jeder Größe und aus allen Sektoren sowie der gesamten Gesellschaft die Möglichkeit geben, die im Framework vorgestellten Ansätze umzusetzen.

Das AI RMF ist in zwei Teile gegliedert. Der erste Teil definiert dabei wichtige Begrifflichkeiten, die im zweiten Teil, der auf die Umsetzungsempfehlungen eingeht, gebraucht werden. Einführend beginnt das AI RMF mit ein paar allgemeinen Bemerkungen zu den Herausforderungen des Risikomanagement, der Schwierigkeit ein Risiko beim KI Einsatz zu messen und dazu wie ineffizient es ist Risiken komplett eliminieren zu wollen.

Der KI-Lebenszyklus und dessen Akteure

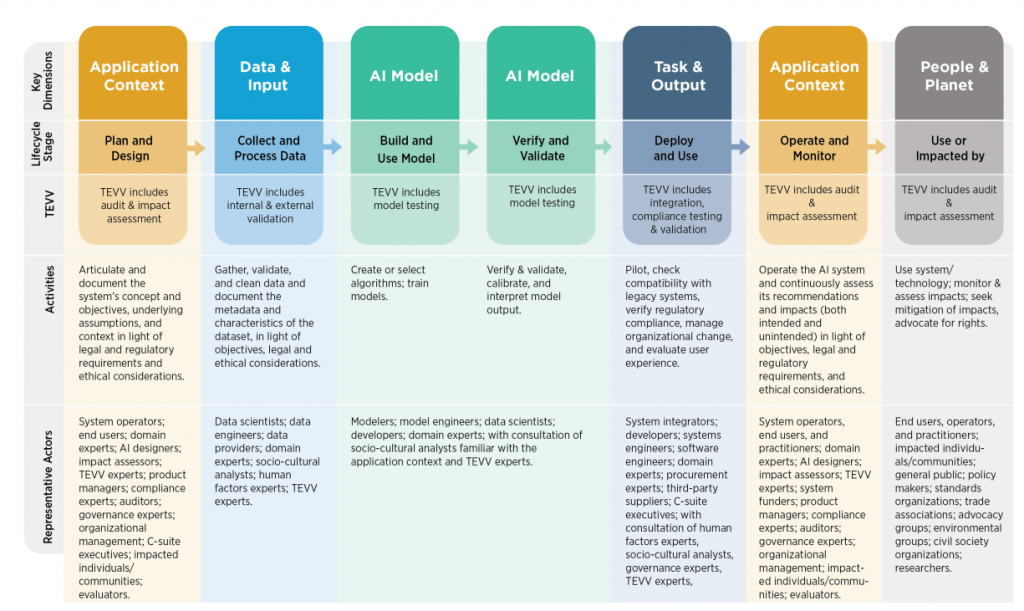

Im folgenden geht die NIST auf die verschiedenen Akteuren im gesamten KI-Lebenszyklus ein. Es hebt die Bedeutung von Tests, Evaluierung, Verifikation und Validierung (TEVV) im KI-Lebenszyklus hervor und legt nahe, dass diese Prozesse regelmäßig durchgeführt werden sollten, um technische, gesellschaftliche, rechtliche und ethische Risiken zu bewerten und zu verwalten.

Das Framework baut auf einem Klassifizierungssystem der OECD auf und erweitert es. Es identifiziert die Hauptdimensionen im KI-Lebenszyklus: Anwendungskontext, Daten und Eingabe, KI-Modell sowie Aufgabe und Ausgabe. Es gibt auch eine zentrale „People & Planet“-Dimension, die Menschenrechte und das allgemeine Wohl der Gesellschaft und des Planeten repräsentiert. Akteure in dieser Dimension bieten Kontext und können Normen für das KI-Risikomanagement festlegen. Dazu gehören unter anderem Handelsverbände, Forschungsorganisationen und Bürgergruppen.

Es ist zu sehen, dass insbesondere Akteure mit spezifischem Know-how in den TEVV-Prozessen (Test, Evaluierung, Verifikation und Validierung) besonders wichtig sind und diese die Aufgaben regelmäßig ausführen sollten, um technische und ethische Standards zu bewerten und Risiken zu verfolgen. Diese TEVV-Aufgaben sollen sowohl für mittelfristige Korrekturen als auch für nachträgliches Risikomanagement sorgen. Die Zusammenfassung packt das AI RMF in die Grafik aus Abbildung 1.

Trustworthy AI

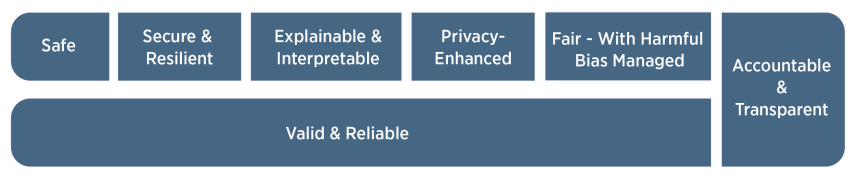

Trustworthy AI (vertrauenswürdige KI) ist eine Begrifflichkeit die immer wieder genommen wird, wenn es um den Einsatz von KI geht. Die europäische Union veröffentlich bereits 2018 eine Leitlinie für Trustworthy AI. Auch das AI RMF nimmt dieses Thema auf und dokumentiert dabei die Eigenschaften, die nach Ansicht der NIST eine Trustworthy AI ausmachen. Diese Eigenschaften umfassen Gültigkeit, Zuverlässigkeit, Sicherheit, Widerstandsfähigkeit, Rechenschaftspflicht, Transparenz, Erklärbarkeit, Interpretierbarkeit, erhöhten Datenschutz und kontrollierten Umgang mit schädlichen Vorurteilen. Das Framework betont, dass diese Eigenschaften je nach dem spezifischen Kontext, in dem das KI-System verwendet wird, ausbalanciert werden müssen. In der Praxis könnte beispielsweise bei KI-Systeme im Gesundheitskontext die Sicherheit (safety) als besonders wichtig erachtet werden, während in einem journalistischen Kontext Transparenz und Rechenschaftspflicht im Vordergrund stehen. In einem Kontext, der personenbezogene Daten verarbeitet, wäre der Datenschutz (privacy-enhanced) vielleicht besonders kritisch. Insgesamt soll die Konzentration auf diese Eigenschaften KI-Systeme vertrauenswürdiger machen und Risiken minimieren.

Bemerkungen zu den Punkten:

- Gültigkeit (Valid): Dies bezieht sich darauf, ob das KI-System seine beabsichtigten Funktionen erfüllt. Es sollte genau, zuverlässig und auch unter verschiedenen Bedingungen robust sein. Laufende Tests und Überwachung sind nötig, um diese Eigenschaften sicherzustellen.

- Zuverlässigkeit (Reliable): Zuverlässigkeit beschreibt, wie gut das System über einen längeren Zeitraum hinweg wie beabsichtigt funktioniert.

- Sicherheit (Safe) wird als Schutz von Menschenleben, Gesundheit, Eigentum und Umwelt definiert. Hierzu gehören verantwortungsvolle Gestaltung und Einsatz des Systems sowie klare Informationen für die Nutzer. Risikomanagement-Ansätze sollten sich an bestehenden Leitlinien in relevanten Bereichen wie z.B. Arbeitsschutz oder Gesundheitswesen orientieren.

- Sicherheit und Resilienz (Secure & Resilient): KI-Systeme sollten in der Lage sein, unerwartete Ereignisse oder Änderungen zu bewältigen und Schutzmechanismen gegen nicht autorisierten Zugriff zu haben.

- Verantwortlichkeit und Transparenz (Accountable & Transparent) : Für vertrauenswürdige KI ist Verantwortlichkeit, die auf Transparenz basiert, entscheidend. Transparenz sollte alle Aspekte des KI-Lebenszyklus abdecken und den Nutzern ermöglichen, die Funktionsweise und Entscheidungen des Systems zu verstehen.

- Erklärbare und Interpretierbare KI (Explainable & Interpretable): Erklärbarkeit beschreibt, wie ein KI-System funktioniert, während Interpretierbarkeit sich auf das Verständnis der Ausgabe in ihrem Kontext bezieht. Beide Konzepte helfen Nutzern und Aufsichtspersonen, das System besser zu verstehen und ihm zu vertrauen.

- Datenschutz (Privacy Enhanced): Schutz der Privatsphäre ist wichtig für die Autonomie und Würde des Menschen. Technologien und Methoden, die die Privatsphäre verbessern, sollten in der Gestaltung der KI-Systeme berücksichtigt werden, wobei jedoch Kompromisse in Bezug auf Genauigkeit und Fairness möglich sind.

- Umgang mit schädlichen Vorurteilen (Fair – and harmful bias managed): Fairness in KI ist komplex und kulturspezifisch. Neben dem Abbau schädlicher Vorurteile sollte das System auch den digitalen Graben und andere soziale Ungleichheiten berücksichtigen. Es gibt verschiedene Arten von Vorurteilen, einschließlich systemischer, rechnerischer und menschlich-kognitiver Vorurteile, die alle im gesamten KI-Lebenszyklus berücksichtigt werden sollten.

AI RMF Core

Die Kernkomponente des AI-Risikomanagement-Frameworks (AI RMF Core) besteht aus diversen Controls, die beim Risikomanagement helfen soll. Der Core ist in vier Hauptfunktionen unterteilt: GOVERN, MAP, MEASURE und MANAGE. Diese Funktionen werden weiter in Kategorien und Unterkategorien zerlegt, die spezifische Aktionen und Ergebnisse umfassen. Dabei handelt es sich nicht um eine Checkliste oder eine zwangsläufig geordnete Abfolge von Schritten, sondern um Empfehlungen, die helfen können das Risikomanagement einzuführen und zu pflegen.

Govern 1

Die Controls von Govern 1 adressieren Richtlinien, Prozesse, Verfahren und Praktiken im gesamten Unternehmen, die sich auf die Erfassung, Messung und das Management von KI-Risiken beziehen. Wer bereits ein Risikomanagement für die ISO 27001 eingeführt hat dürfte die wesentlichen Elemente wiedererkennen. Interne und externe Stakeholder und deren Anforderungen definieren, Erstellung einer Inventarliste, definieren von Richtlinien und Verantwortlichkeiten und die Bereitstellung von Ressourcen. Die Prozesse rund um die Risikoerfassung müssen natürlich definiert und später auditiert werden. Aspekte hinsichtlich KI-Systeme ist insbesondere das Einbinden der KI Akteuere entlang des Lifecyles und deren Akteure. Insbesondere TEVV spielt dabei eine wesentliche Rolle, da dies als Meßinstrument genutzt wird. Hier sollen Fachexperten (SME) die entsprechenden Vorgaben dokumentieren, so dass diese kontinuierlich überwacht werden können. Ein Auszug findet sich in folgender Tabelle. Im AI RMF Playbook sind die einzelnen Punkte genauer beschrieben.

| Bemerkung | Maßnahmen | Dokumentation | |

|---|---|---|---|

| GOVERN 1.1 | Verständnis für rechtliche und regulatorische Anforderungen an KI. |

|

|

| GOVERN 1.2 | Die Eigenschaften von trustworthy AI sind in den Unternehmensrichtlinien integriert. |

|

|

| GOVERN 1.3 | Prozesse zur Bestimmung des erforderlichen Risikobewertung. |

|

|

| GOVERN 1.4 | Transparente Richtlinien für die Aktuere im KI-Lebenszyklus etablieren. |

|

|

| GOVERN 1.5 | Kontinuierliche Überwachung |

|

|

| GOVERN 1.6 | Inventarisierung der KI-Systeme. |

|

|

| GOVERN 1.7 | Prozesse und Verfahren für die sichere Außerbetriebnahme von KI-Systemen. |

|

|

Govern 2

Govern 2 enthält 3 Unterpunkte. Diese betrachten die Strukturen und Maßnahmen, die für das Risikomanagement im Kontext KI notwendig sind. Es werden Verantwortlichkeiten klar definiert. Hierbei geht es von der Rolle des Board of Directors über Riskmanager des KI-Systems bis hin zu Auditoren. Dabei wird der Schwerpunkt darauf gelegt, dass sowohl technische Teams als auch Führungskräfte geschult werden, um Ihre Verantwortkung für das Management von KI-Risiken warnehmen zu können. Es wird vorgeschlagen, Richtlinien und Schulungsprogramme einzurichten, die sich sowohl auf die technischen als auch auf die sozio-technischen Aspekte des Risikomanagements beziehen. Das Ziel ist, eine Organisation zu schaffen, die Risiken proaktiv antizipieren und steuern kann. Zudem wird betont, dass die höchste Führungsebene der Organisation für Entscheidungen über KI-bezogene Risiken verantwortlich ist, aber natürlich den Prozess um das Management delegieren kann. Ein Auszug der wesentlichen Aspekte folgt in Tabelle 2.

| Bemerkung | Maßnahmen | Dokumentation | |

|---|---|---|---|

| GOVERN 2.1 | Rollen, Verantwortlichkeiten und Kommunikationswege im Zusammenhang mit der Steuerung von KI-Risiken sind definiert und dokumentiert. |

|

|

| GOVERN 2.2 | Die involvierten Personen erhalten eine Schulung im Risikomanagement für KI. |

|

|

| GOVERN 2.3 | Das Top-Management muss involviert werden. |

|

|